Dünyamız, son bir kaç yıldır yapay zekanın baş döndürücü gelişmelerini takip etmekle geçti. Öyle ki AI/LLM dünyası şüphesiz hepimizin hayatının bir parçası olmuş durumda. Kimileri bunun farkında, kimileri farkında değil.

Yapay Zeka’da Vahşi Batı vs. Kovboylar

AI araçlarının, gündelik hayatlarımızı son derece kolaylaştırması ve süreçlerimizi hızlandırması nedeniyle “kontrolsüzce” hayatımıza hızlıca adapte oldu. Bu kontrolsüz adaptasyon süreci de beraberinde “vahşi batı” atmosferini de beraberinde getirdi. Gartner’ın yayınladığı raporlarda, bu kontrolsüz dönemin artık sürdürebilir olmadığını net bir şekilde ortaya koyuyor. AI araçları artık sıradan bir “verimlilik” araçları olmaktan çıktı; kurumların sinir sistemlerine entegre olan otonom operasyonel bir güce dönüştü.

Sektör, basit “AI Agent”-lardan, kendi başına eyleme geçebilen bir “otonom ajanlara” doğru hızla evrilirken, güvenlik stratejileri bu evrimin gerisinde kalıyor. Kurumlar artık ilgili modelleri kullanmak değil, yapay zekanın yarattığı otonom sistemleri nasıl dizginleyecekleri ile ilgileniyor.

Ofisinizdeki Gizli Misafir: Gölge AI Araçları (Shadow AI)

Organizasyonlar artık BT departmanlarının onayı dışında kullanılan yapay zeka araçlarının, kurumsal görünürlüğün en büyük kara deliği haline geldiğinin farkında. Gartner Peer Insight verileri, çalışanların verimlilikleri uğruna “Gölge Yapay Zeka” araçlarının kullanımının standartlaştığını gösteriyor. Bu bir tercih değil, yönetilmesi gereken bir stratejik risk yüzeyi olduğunu kabul etmemiz gerekiyor.

Yapay zeka güvenliğini sağlamayı amaçlayan platformlar, şirket ağlarında 500‘den fazla yapay zeka araçlarını sunmakla kalmıyor, ISO 42001 ve EU aI Act gibi kritik regülasyonlara uyumları da denetliyor.

Çalışanlar ChatGPT, Gemini, Claude, Kimi vb. araçları gün geçtikçe daha da benimsiyor. Bu benimsemenin önüne geçmek yerine, görünürlüğü sağlamamız gerekiyor.

Asistanlardan Ajanlara Evrim ile Risk Değişimi

Gartner’ın pazar kategorilerindeki en köklü değişim, “AI Kod Asistanlarından” “AI Kod Ajanlarına” geçişte yaşanıyor. Asistanlar, kod önerisi sunarken, ajanlarla uygulama mimarilerini değiştiren ve API’leri bağımsızca çağıran yapılar devrede. Sadece bu durum bile eski, geleneksel statik kod analizlerini bile yetersiz kılıyor.

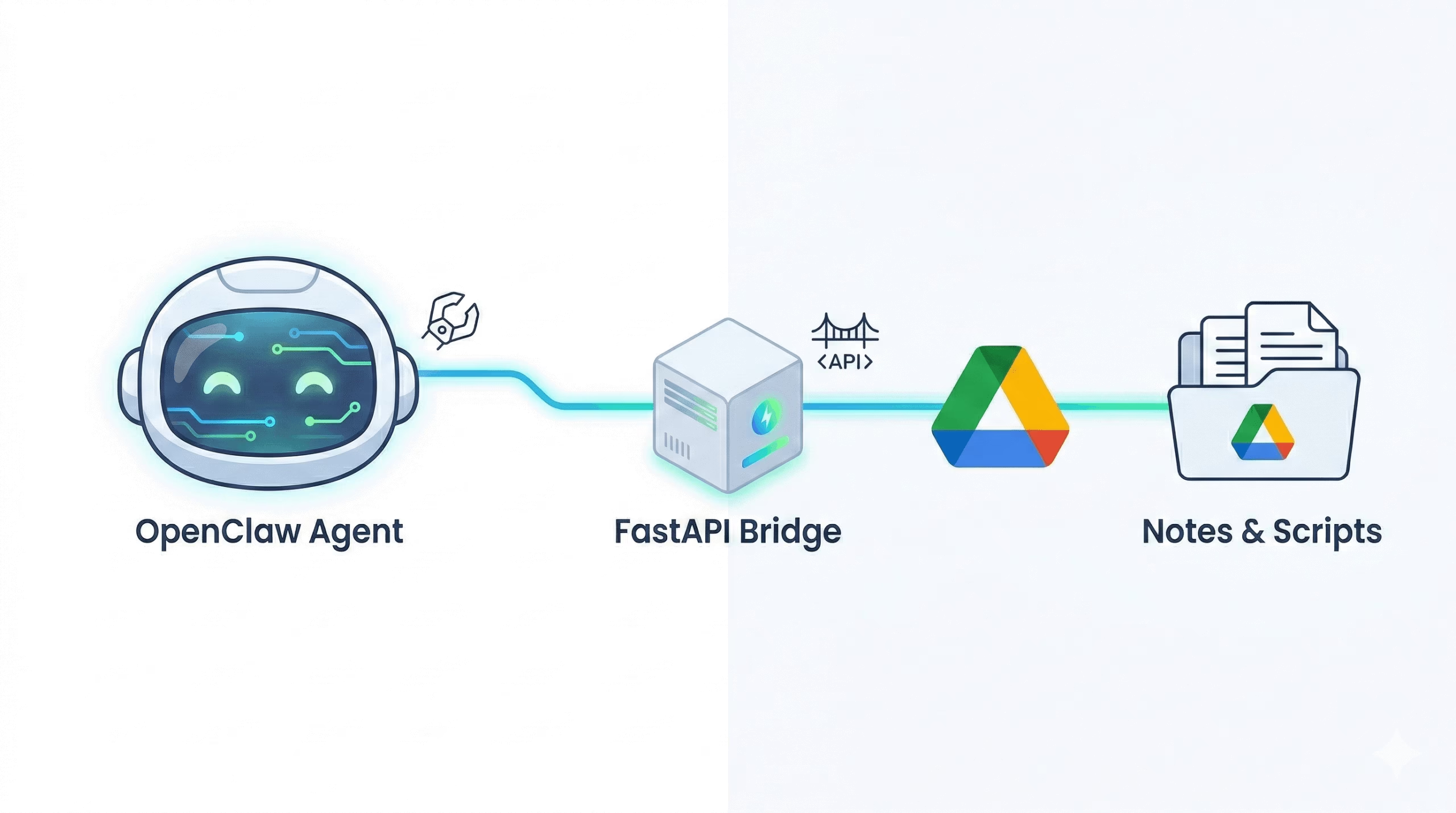

Artık tam yaşam döngüsü kapsamı (full-lifecycle coverage), bir ajanın sadece ne yazdığını değil, aracın başka hangi araçları çağırdığını (tool invocation) ve bu araçların nasıl davrandığını izlemeyi gerektiriyor. AI güvenlik araçları MCP (Model Context Protokol) üzerinden gerçek zamanlı politika yönetimi sağlayarak, riskli eylemleri daha gerçekleşmeden engellemeyi hedefliyor.

Runtime Savunması: Halüsinasyon ve Toksisiteye Karşı Koruma

AI güvenliği sadece güvenlik duvarları ile saldırılara karşı duvar örmek değildir. AI Security ve Anomaly Detection pazarı, modelin kendi kendine ürettiği “kusurlu” sonuçları engellemeye odaklanıyor. Bu aşamada da hem gelen sorguları hem de modelin ürettiği yanıtları eBPF konnektörleri sayesinde sistem çağrıları, network trafiği ve proccess davranışları içgörülerle analizi ile Prompt Injection, Halüsinasyon ve Yanlılık ve Veri Sızıntılarına karşı koruma sağlıyor.

İnsan Olmayan Kimlikler: Bot vs. API Güvenlik Savaşları

Güvenlik açıkları artık sadece insan veya config hatalarından kaynaklanmıyor. Özellikle yönetilemeyen 3. taraf entegrasyonlar ve veri akışlarının entegrasyonları oldukça kompleks hale gelmiş durumda. Bu durumda API, servis hesapları ve entegrasyonlarda ki veri akışlarını haritalandırarak; kimin, hangi veriye neden eriştiğini bilmeyi şart haline getiriyor.

Yeni Standart: Ajan Tabanlı Güvenlik Yönetimi (Agentic SPM)

Agentic SPM (Agentic Security Posture Management) tanımını önümüzde ki günlerde daha sık duyacağız. Bu yaklaşım, ajanların sahip olduğu aşırı yetkileri (excessive privilege) ve riskli erişim yollarını sürekli takip ederek, geleneksel güvenlikten ayrılıyor.

Gartner’ın 3’lü Yaklaşımı

Gartner, AI güvenliği yaklaşımını 3’e bölmüş durumda. Bunlar:

- Development Stage (AI Application Security): İlk aşama olarak karşımıza çıkıyor. AI sistemini güvenli bir şekilde inşa etmeninde kendi içerisinde 4 adımdan oluşuyor. Bunlar:

- Model & Data Güvenliği: Training verinin temizliği, data poisoning riskleri, hassas veriler.

- Supply Chain Security: Kullanılan model nereden geliyor? Model güvenirli mi? Dependencyler temiz mi?

- API & Entegrasyon Güvenliği: LLM API Key’ler nasıl saklanıyor? Rate Limit / Auth kontrolleri.

- Prompt Engineer: Promptlar manipülasyona açık mı? System prompt leak tehlikesi var mı?

- AI Security Testing / Red Team: Kurulan AI aracının red team olarak test edilmesi adımıdır. Bu adımı da 5 aşamada inceleyebiliriz.

- Prompt Injection Testleri

- Jailbreak Testleri

- Adversarial Input

- Data Exfiltration Test

- Halüsinasyon Testi

- Runtime Güvenliği (AI Security & Anomali Tespiti)

- Governance (Shadow AI + Data Kontrol)