LLM modeller, artık hayatımızın değişmez bir parçası olma yolunda hızla ilerliyor. Özellikle 2026’dan itibaren LLM ve türevlerinde daha da fazla bir artış olacağı aşikar. Bu yazıyı yazarken, sadece Hugging Face‘de yüz binlerce, herkesin kullanıma açık LLM ve türevleri bulunuyor.

Peki; LLM’lerin daha üstü ne olabilir?

LLM’lerin Temel Sorunları

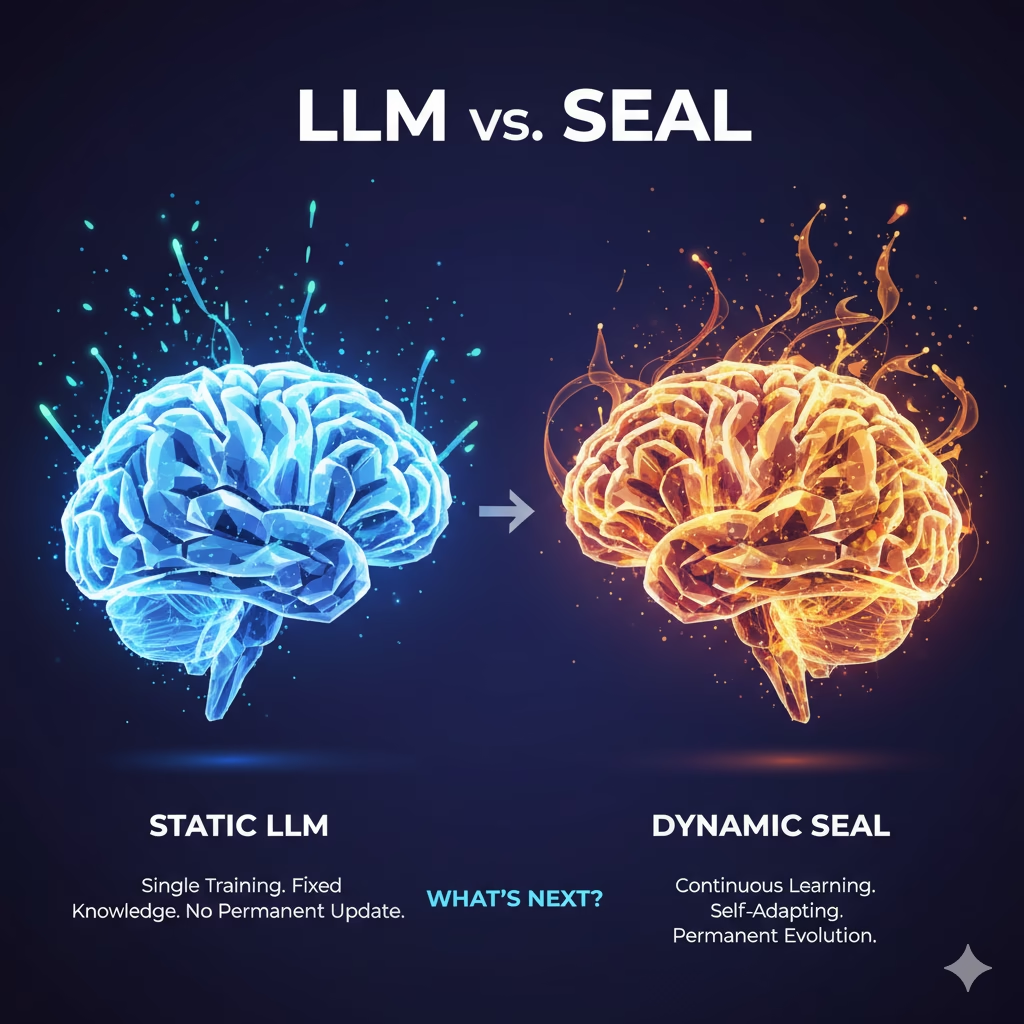

ChatGPT, Gemini, Grok, Copilot gibi LLM’ler genelde statik dil modelleri olarak karşımıza çıkıyor. Bu büyük dil modelleri, uzun ve zorlu bir eğitim aşamasından sonra edindikleri temel bilgilerini, yeni görev ve bilgilere göre kolayca güncelleyemiyorlar. Var olan bilgilerinin üzerine, yeni bir bilgi öğrendiklerinde, bu bilgileri kalıcı hale getirmekte zorlanıyorlar.

Basit bir örnek vermek gerekirse; bir LLM’e ‘Tavuk yumurtadan çıkar’ dediğinizi varsayalım. O anki sohbette bu bilgiyi kullanacaktır. Ancak sohbeti kapatıp yeni bir sohbet açtığınızda, bu bilgiyi tamamen unutur ve yine kendi orijinal eğitim verisindeki (belki de bu konuda kararsız olan) haline döner. Yeni bilgiyi kalıcı hafızasına, yani çekirdek yapısına, işlemesinin tek yolu, tüm modeli yeniden eğitmektir ki bu da aylar süren maliyetli bir iştir.

Bu zorluğun nedeni ise, bu tip LLM’ler milyarlarca veri ile sadece bir kez eğitilmesidir ve bu yüzden ilk eğitim dışında ki eğitimlerin kalıcı olamamasıdır.

SEAL’lerin Farkı Nedir?

SEAL (Self-Adapting LLMs) dil modellerini, ders çalışmasını bilen bir öğrenciye benzetebiliriz. Bu yüzden de LLM’ler gibi statik değil, dinamiktir. SEAL dil modellerinde örneğin yeni bir gerçek veya az örnekli bir problem verildiğinde model, “kendi kendini düzenleme” talimatı oluşturur.

Kendi kendini düzenleyebilen SEAL’ler, nasıl ince bir ayar yapacaklarını bildikleri için “bu bilgiyi öğrenmek için, şu sentetik verileri oluştur ve kendini eğit” diyebilirler ve bu sayede model kendisini kalıcı olarak değiştirir.

SEAL, modelin doğru güncellemeleri yapmayı öğrenmesi için reinforcement learning (RL), yani takviyeli öğrenmeyi benimsiyor. Yani ilgili dil modeli, görevinde başarılı olduğunda, o tür güncellemeler yapmayı öğreniyor.

Daha net olabilmesi için örneğin “Türkiye’nin Coğrafi Yapısı” bilgileri LLM modellerine daha öncesinde öğretilmiş bir bilgi iken, SEAL’lerde işleyiş şöyle olur:

- SEAL ilk önce verilen komutu analiz eder.

- Sonrasında klasik LLM’lerin aksine sadece bilgiyi okumaz, kendisine bir çalışma metodolojisi çıkarır. Örneğin:

- Bu metinde en kritik bilgi ne? Türkiye’nin konumu, iklimi ve toprak yapısı. Bu bilgileri kalıcı hale getirmeliyim.

- Bu bilgiyi nasıl öğrenirim? Kendimi “Türkiye’nin iklimi nasıldır?” konusunda sorular ve cevaplar oluşturmalıyım.

- Bu metinden nasıl mantıksal çıkarımlar yapabilirim? Örneğin: “Karadeniz bölgesi çok yağış aldığına göre, bitki örtüsü ormanlıktır.”

- Bu tip bilgileri öğrenen SEAL, öğrendiği verileri kalıcı hale getirmeden önce kendisini bir teste sokarak verileri kontrol ederek, kendisini eğitir.

- İşlem başarılı olursa, bunu iyi bir öğrenme stratejisi olarak görür. Bu aşamaya da RL denir.

Tüm süreçleri başarı ile tamamlarsa, iç döngüye başlar. Bu aşama bilgiyi kaydetme kısmıdır, işlem başarılı olursa, bunu iyi bir öğrenme stratejisi (bir ‘self-edit’ talimatı) olarak görür. Bu aşamaya RL denir.

Bu başarılı ‘self-edit’ talimatı onaylandıktan sonra İç Döngü başlar. Model, bu talimatı kullanarak Denetimli İnce Ayar (SFT) yöntemiyle kendi çekirdek yapısını (ağırlıklarını) kalıcı olarak günceller.

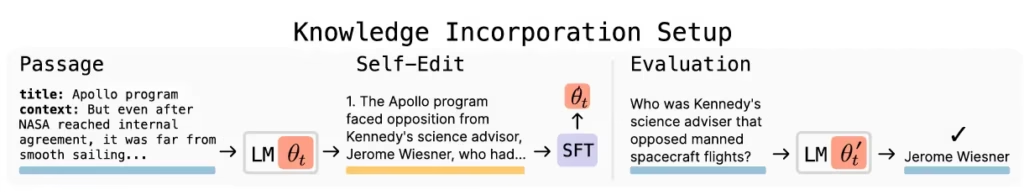

Yukarıda görselde SEAL’in bilgi-birikimini nasıl yaptığını görebiliriz. Burada:

- Passage (Metin): Bu adımda, modele yeni bir bilgi veriliyor. Örnekte ki bilgimiz Apollo programı hakkında bir metin. Burada modelimizi “eski model” olarak adlandırıyoruz.

- Self-Edit: Model bu bilgiyi alıp, kalıcı olarak öğrenmesi gereken en kritik bilgi olan Jerome Wiesner’ın kim olduğunu çıkarıp, bunu bir eğitim talimatı formatına çeviriyor.

- SFT: Model, ürettiği bilgiyi “Self-Edit” talimatı ile kendi çekirdeğine işliyor ve güncellenmiş model haline dönüşüyor.

- Evaluation (Değerlendirme): Yeni model, veriyi gerçekten öğrenip-öğrenemediğini test sorusuyla kontrol ediyor. Doğru cevap verildiğinde süreç başarılır olarak kabul ediliyor.

| Yöntem | LLM | Geçici Öğrenme (In-Context Learning) | SEAL |

| Nasıl Çalışır | Tek bir öğrenim ile bilgi kapasitesini doldurur. | Modele bir veri verilir. (Örnek: Bu word dosyasını oku ve özetle.) | Kendi kendini eğitir. |

| Kalıcı Öğrenme Var Mı? | Sadece ilk eğitimde. | Hayır. Sohbet kapatılınca veriler silinir. | Evet, modelin temel yapısına işlenir. |

| Öğrenme Süreci | İnsanlar tarafından yönetilen, devasa ve yavaş öğrenim süreci. | Anlık, hızlı ama geçici. | Otomatik ve sürekli. |

SEAL’in Dezavantajları

Tabii ki de her model mükemmel değil. Bugünü T0 anı olarak alırsak belli dezavantajları ise şunlar;

- Hesaplama Yükü: Yukarıda SEAL’in süreçlerinden bahsetmeye çalıştım. Süreçten de anlaşılacağı üzere modelin işlem sayısı oldukça fazla ve her süreç oralama 30-45 saniye sürebiliyor.

- Veri İhtiyacı: SEAL’ın başarılı olup, olmadığını anlayabilmesi için verilerle ilgili spesifik soru-cevaplara ihtiyacı bulunuyor. Sadece ham bir veriyi alıp, “bundan ne öğrenmem lazım” sorusunu sormakta zorlanıyor.

- Otonom Zeka: Bu tip modellerin soru sorma biçimlerini öğrenmesi, soru sorma zekasını kazanması gerekiyor.

- Katastrofik Unutma: SEAL’in karşılaştığı en büyük zorluk budur. Model, yeni bilgileri öğrenmek için kendini güncellerken, daha önce öğrendiği eski ve değerli bilgileri unutabilir veya bozabilir. Yeni bilgilerin, eski bilgilerin üzerine ‘yıkıcı bir şekilde’ yazmasını engelleyecek mekanizmalar henüz tam olarak çözülmemiştir.