Maalesef bu konu da yardımcı olamam.

Llama3, Gemma vb. bir büyük dil modelleri ile çalışıyorsanız bu sonucu sıklıkla okumuşsunuzdur. Günümüzde LLM’ler, piyasaya sürülmeden önce kapsamlı bir “Güvenlik Eğitimi”‘nden (Safety Alignment) geçerler. Bu eğitimlerle LLM’lerin zararlı, etik dışı veya tehlikeli bulunan soruların direk red edilmesini sağlar.

Bazen bu filtreler oldukça agresif olup, gerçekten elde edinmek istenen sonuçları, teknik araçları vs. engeller.

Heretic Nedir?

Heretic, açık kaynak kodlu LLM frameworkü olan PyTorch tabanlı, Python dilinde geliştirilmiş bir araç. Temel amacı, eğitilmiş bir dil modelinin içerisinde ki reddetme mekanizmasını bulup, modelin diğer yeteneklerini etilemeden güvenlik ayarlarını minimize etmek, hatta etkisiz hale getirmektir.

Normal şartlarda bir dil modelini sansürsüz (uncensored) hale getirmek için ilgili modeli baştan eğitilmesi (fine-tuning) gerekir. Bu da güçlü bir donanım maliyeti de beraberinde getiriyor.

Heretic ile bu eğitimi tekrarlamadan, model üzerinde matematiksel işlemlerle hızlıca gerçekleştiriyorsunuz.

Hangi Teknikler Kullanılıyor?

Yönlü Ablasyon (Directional Ablation)

Heretic’in en önemli tekniği diyebiliriz. Bu sihir, Refusal Direction (Reddetme Yönü) olarak adlandırılıyor.

LLM’lerin denkleminde, yani latent space (matematiksel uzay) düzleminde, bir modelin soruya “Hayır” demesini tetikleyen sağlayan bir vektör bulunuyor. Bir benzetme ile pusulada ki “Kuzey” yönü gibi, LLM’lerinde bir “Reddetme” yönü bulunuyor. Modelde sorgulama veya düşünce yönü buraya döndüğü anda bizlere “Maalesef bu konu da yardımcı olamam.” şeklinde bir dönüş yapıyor.

Yönlü Ablasyon tekniği ise tam burada araya giriyor:

- İlk olarak modele zararlı ve zararsız promptlar girerek, aradaki fark analiz ediliyor.

- Bu farkları analiz ederek “Reddetme Yönü” yani refusal direction hesaplanıyor.

- Modelde ki ağırlık matrislerinden bu yönü matematiksel olarak çıkarır, yani ablate eder.

Böylece modeli yeniden eğitmek gerekeden ve modelde ki yetenekleri bozmadan “frenleme” mekanizması atlatılmış olur.

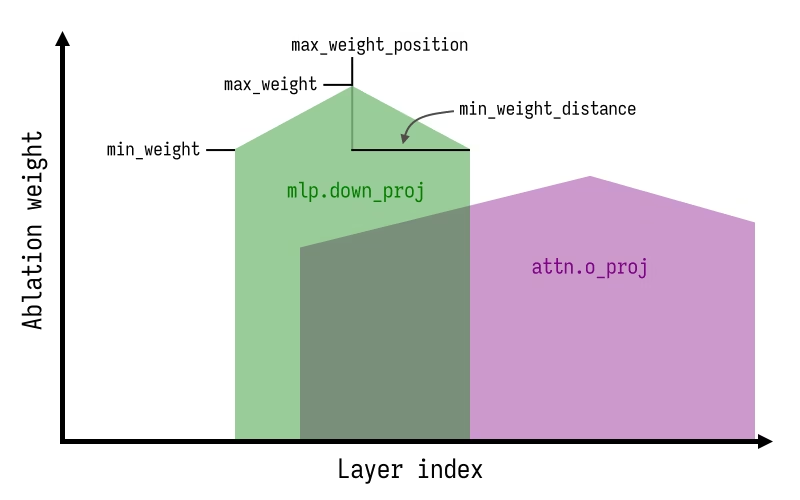

Yapay Zeka modelleri katmanlı bir yapıya sahip. Bundan dolayı da sansür mekanizması belirli katmanlarda daha çok bulunuyor. Yukarıda ki grafik, Heretic’in her katmana aynı müdahaleyi yapmadığını, bunun yerine müdahale şiddetini (ablation weight) katmanlara göre özel bir eğri ile ayarladığını gösteriyor. Bu sayede dil modelinin yeteneklerine zarar vermeden, sadece sansürün yoğun olduğu kısımlara odaklanılıyor.

Daha Az “Beyin Hasarı” ile “Maksimum Özgürlük”

Genellikle bir LLM’in sansür mekanizmasına müdahale etmek, genel zekasına zarar verir. Buna da Lobotomy veya Brain Damage adı verilir.

Fakat Heretic’in varsayılan ayarlarıyla ve herhangi bir müdahale olmadan oldukça başarılı bir sonuç veriyor.Aşağıda ki tabloda 19 Kasım 2025 tarihinde güncel olarak test edilen dil modellerinde reddetme sayısı ve KL Sapması (Orjinalden Uzaklaşma) verileri bulunuyor. Bu veriler RTX 5090 GPU ve PyTorch’un 2.8 versiyonu ile elde edilmiş.

| Model | Zararlı İstekleri Reddetme (100 Üzerinden) | KL Sapması |

| google/gemma-3-12b-it(orjinal) | 97/100 | 0 |

| mlabonne/gemma-3-12b-it-abliterated-v2 | 3/100 | 1.04 |

| huihui-ai/gemma-3-12b-it-abliterated | 3/100 | 0.45 |

| p-e-w/gemma-3-12b-it-heretic (Heretic’in LLM’i) | 3/100 | 0.16 |

Teknik Gereksinimler

Heretic, basit bir script değil. Milyarlarca parametreye sahip neural networks belleğe yüklenerek işlenir. Örnek olarak 8 milyar parametreli (8B) bir modeli işlemek için 24 GB VRAM’e ulaşan bir GPU’ya gereksinim duyar. Ayrıca yazının başında da belirttiğim gibi Python dilinde yazılmış, PyTorch ve Hugging Face Transformers kütüphanelerini kullanır.